从“拍照片”到“拍光谱视频”

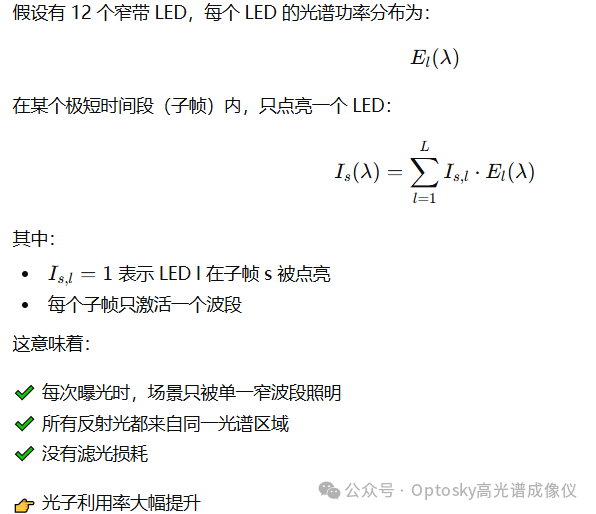

主动光源 + 像素级编码曝光如何实现真正的高光谱视频? 高光谱成像大家并不陌生。 它可以获取 400–700nm 甚至更宽波段范围内的连续光谱信息,让我们看到“肉眼不可见”的物质差异。在农业表型、矿物识别、生物医学、材料分选等领域,高光谱早已成为技术。 但一个问题长期存在: 为什么高光谱大多只能“拍静态”,却很难“拍视频”? 今天,我们从成像原理层面,深入讲解一种“主动光源 + 像素级编码曝光”的高光谱视频思路,并解析它背后的物理机制。 推扫式(线扫) 采集一条空间线 通过运动完成整幅图像 光谱高 无法拍摄快速动态场景 面阵滤光片马赛克(MSFA) 每个像素覆盖不同波段滤光片 单次曝光获得多波段信息 每个像素只接收部分光谱 → 光子利用率低 噪声高、动态范围受限 CASSI / DOE 光学压缩系统 通过衍射或编码孔径压缩光谱信息 单帧完成采集 光学系统复杂 运动时出现空间-光谱混叠 矛盾在于 光谱分辨率 ↑ → 光能被分得更细 → 单波段光子数 ↓ → 曝光时间必须变长 → 无法拍视频 把“光谱调制”从被动滤光片转移到主动光源 传统系统是: 用滤光片“丢掉”不需要的光 新思路是: 主动发出“需要的光”

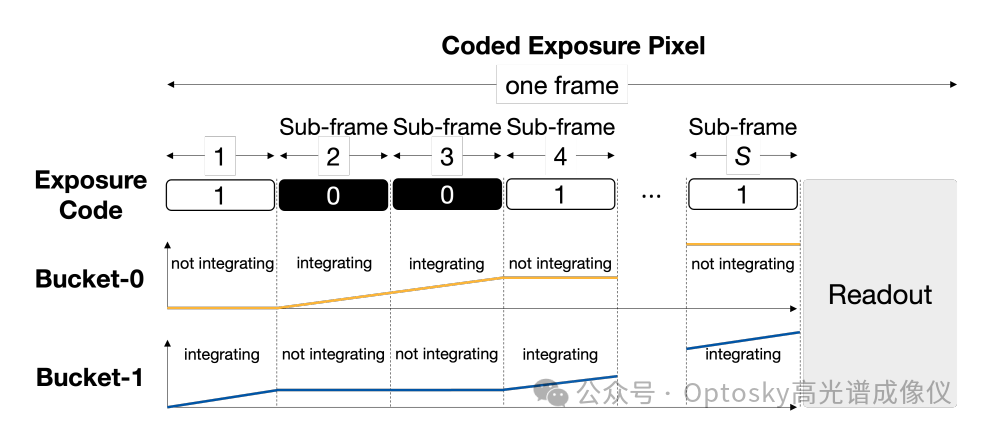

像素级编码曝光(CEP)

普通 CMOS 的限制 普通相机: 整个传感器统一曝光 不能在同一帧内部做时间编码 而 CEP(Coded Exposure Pixel)传感器具有两个特点: ① 每个像素有两个电荷桶(Bucket 0 / Bucket 1) ② 每个像素可以在微秒级别控制: 当前子帧 → 把光子存进哪个桶 子帧机制 假设一帧时间 27ms 在每个子帧内: LED 按计划点亮 每个像素根据编码决定是否积分

被分成 158 个子帧

每个子帧 170μs